Le duel entre Anthropic et OpenAI ne se joue plus seulement sur des benchmarks, mais sur la capacité à sécuriser l’accès au calcul, à verrouiller la chaîne de valeur logicielle et à rassurer les entreprises sur la gouvernance des données. Avec Claude Opus 4.6 et GPT-5.3 Codex, la compétition se déplace vers l’industrialisation, la distribution et la résilience face aux risques géopolitiques et à la copie.

Février 2026 marque une nouvelle accélération dans la rivalité entre OpenAI et Anthropic, avec deux annonces qui, au-delà de l’effet vitrine, signalent un changement de phase. D’un côté, GPT-5.3 Codex vise explicitement le cœur de la production logicielle, là où la valeur se mesure en temps de cycle, en qualité de code, en réduction du risque et en intégration aux chaînes CI/CD. De l’autre, Claude Opus 4.6 pousse l’argument de la robustesse conversationnelle et de la fiabilité en contexte d’entreprise, avec une promesse implicite de maîtrise des comportements et de meilleure tenue sur des tâches longues. Pris isolément, ces lancements ressemblent à une itération de plus dans une course à la performance. Pris ensemble, ils dessinent une guerre d’écosystème où le modèle n’est plus le produit final, mais un composant stratégique d’une pile complète allant du calcul à la distribution, en passant par la sécurité et la conformité.

Deux lancements, une même obsession industrielle

Le choix des dénominations et des cibles est révélateur. En mettant Codex au centre de GPT-5.3, OpenAI réactive une marque associée à l’assistance au développement, mais dans un contexte radicalement différent de celui des premiers copilotes. Le marché a mûri, les entreprises ont instrumenté des garde-fous, et la demande se déplace vers des agents capables de naviguer des bases de code, d’exécuter des tests, de proposer des correctifs et de documenter, tout en restant auditables. Anthropic, avec Claude Opus 4.6, joue une partition complémentaire mais concurrente, orientée vers la fiabilité et la capacité à tenir des interactions complexes sans dérive, un point devenu central dès lors que les modèles sont branchés sur des outils internes et des données sensibles. Dans les deux cas, l’enjeu n’est pas seulement d’être « meilleur » en absolu, mais d’être plus prévisible, plus intégrable et plus rentable à opérer.

Cette rentabilité est la contrainte structurante. Les modèles de pointe sont désormais des systèmes industriels dont le coût marginal dépend du prix du calcul, de l’efficacité d’inférence, de la disponibilité GPU et de l’optimisation logicielle. Or OpenAI se heurte à une limite matérielle et organisationnelle qui pèse sur sa capacité à livrer au rythme promis. Les tensions autour de l’infrastructure ne sont plus un bruit de fond, elles deviennent un facteur de compétitivité. Le retard d’un grand projet d’infrastructure peut se traduire par des arbitrages sur les quotas, les prix, la latence ou la disponibilité régionale, autant de variables qui comptent davantage pour un DSI que quelques points de score sur un benchmark. C’est dans ce contexte que le projet Stargate accumule les retards, rappelant que l’avantage algorithmique ne suffit pas si la chaîne d’approvisionnement en calcul n’est pas maîtrisée.

La compétition se déplace vers la distribution et la confiance

Le front le plus décisif se situe probablement dans la distribution. GPT-5.3 Codex vise l’endroit où les développeurs passent leurs journées, c’est-à-dire l’IDE, le dépôt Git, le ticketing, l’observabilité et les pipelines. Celui qui s’insère le plus profondément dans ces workflows devient difficile à remplacer, car il capte le contexte, standardise les pratiques et crée une dépendance aux intégrations. Anthropic, historiquement plus fort sur l’argument « safety » et sur une relation de confiance avec certaines entreprises, doit transformer cet avantage en présence opérationnelle, via des partenariats cloud, des offres managées, et des garanties contractuelles sur la confidentialité et la non-réutilisation des données. La bataille n’est donc pas seulement OpenAI contre Anthropic, mais aussi leurs alliances respectives avec les hyperscalers, les plateformes de développement et les éditeurs de logiciels d’entreprise.

Cette dimension « confiance » est exacerbée par deux pressions. La première est géopolitique et réglementaire. Les entreprises européennes, en particulier, arbitrent de plus en plus entre performance et souveraineté, et cherchent des options d’hébergement, de chiffrement et de contrôle d’accès qui réduisent l’exposition extraterritoriale. Le débat n’est pas théorique: certaines grandes entreprises européennes inquiètes pour la sécurité de leurs données entament une migration vers des solutions françaises, signe que la dépendance aux acteurs américains est désormais perçue comme un risque opérationnel. Même si OpenAI et Anthropic sont américains, cette tendance rejaillit sur leurs stratégies produit, car elle pousse à proposer des modes de déploiement plus flexibles, des garanties de résidence des données et des mécanismes d’audit plus solides.

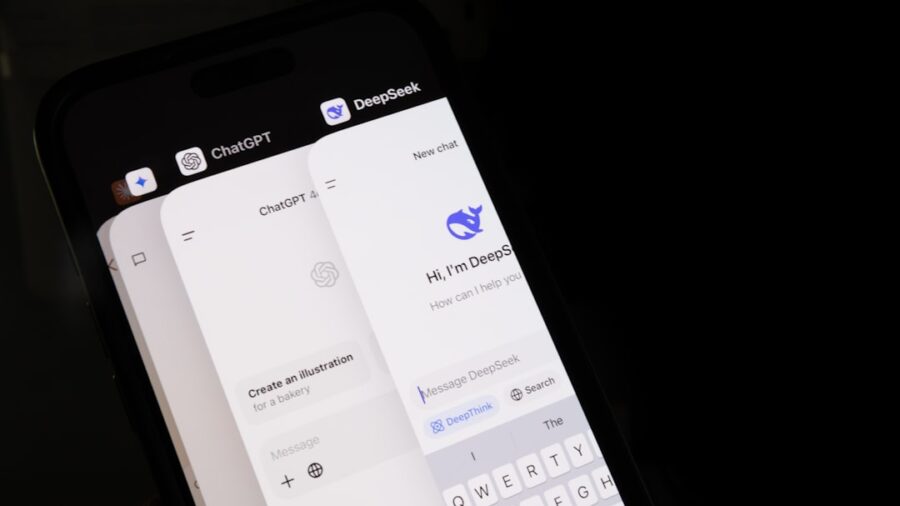

La seconde pression est la protection du capital modèle. Les accusations de distillation et de copie, déjà visibles dans l’industrie, transforment la question de la propriété intellectuelle en enjeu de sécurité. Pour un acteur comme Anthropic, la capacité à empêcher l’exfiltration de comportements via des attaques par requêtes, ou à détecter des patterns de distillation, devient un élément de différenciation autant qu’un coût. Le sujet est d’autant plus sensible que la valeur d’un modèle se diffuse rapidement dès qu’il est accessible via API. Dans ce contexte, Anthropic accuse des IA chinoises d’avoir mené des attaques par distillation afin de copier les capacités de Claude, ce qui éclaire une réalité: la compétition ne se limite plus aux acteurs occidentaux, et la défense contre la copie devient une ligne budgétaire permanente, au même titre que l’entraînement ou l’inférence.

Ce que les DSI et les CTO doivent vraiment mesurer

Pour les décideurs techniques, l’annonce d’un nouveau modèle doit être lue comme un signal, pas comme une preuve. Trois critères dominent désormais les choix. D’abord, la stabilité opérationnelle: disponibilité, latence, gestion des pics, et capacité à garantir des SLA compatibles avec des usages critiques. Ensuite, la gouvernance: traçabilité des sorties, politiques de rétention, options de non-entraînement, et outillage de conformité. Enfin, l’intégration: connecteurs, capacités agentiques, exécution d’outils, et compatibilité avec les environnements de développement et de sécurité existants. Sur ces trois axes, la contrainte de calcul d’OpenAI et la pression concurrentielle sur Anthropic convergent vers un même résultat: l’innovation visible se double d’une industrialisation invisible, faite d’optimisations, de segmentation d’offres et de packaging.

La conséquence stratégique est claire: la valeur se déplace vers les couches d’orchestration et de contrôle. Les entreprises qui réussiront ne seront pas celles qui « choisissent le meilleur modèle », mais celles qui construisent une architecture multi-modèles, avec des politiques de routage par tâche, des garde-fous, et une observabilité fine des coûts et des risques. Dans ce schéma, GPT-5.3 Codex et Claude Opus 4.6 deviennent des briques interchangeables, à condition d’investir dans l’abstraction. À l’inverse, les organisations qui s’enferment dans une intégration propriétaire, séduites par la productivité immédiate, s’exposent à une dépendance tarifaire et technologique, surtout si la disponibilité du calcul se tend ou si les conditions contractuelles évoluent.

Perspectives, une guerre de l’IA qui ressemble de plus en plus à une guerre d’infrastructure

À court terme, la dynamique la plus probable est une polarisation du marché. OpenAI cherchera à capitaliser sur l’écosystème développeur et sur l’effet de réseau des outils, en poussant Codex comme interface naturelle entre intention et production logicielle. Anthropic, de son côté, aura intérêt à renforcer son positionnement entreprise, en mettant l’accent sur la fiabilité, la sécurité et la gouvernance, tout en élargissant sa distribution via des partenaires capables d’offrir des options d’hébergement et de conformité. Mais la variable la plus déterminante restera l’accès au calcul, car elle conditionne la cadence des releases, la compétitivité prix et la capacité à servir des clients globaux avec des garanties fortes.

À moyen terme, la compétition devrait s’étendre sur trois terrains. Le premier est l’efficience, avec des modèles plus frugaux, des techniques d’inférence optimisées et une segmentation fine entre modèles généralistes et spécialistes. Le deuxième est la sécurisation, à la fois contre la fuite de données et contre la distillation, ce qui pourrait accélérer l’adoption de mécanismes de watermarking, de détection d’abus et de politiques d’accès plus strictes. Le troisième est la souveraineté opérationnelle, sous la pression combinée des régulateurs et des clients, qui exigeront davantage de contrôle sur l’endroit où tournent les modèles et sur la manière dont ils sont gouvernés. Dans ce cadre, Claude Opus 4.6 et GPT-5.3 Codex ne sont pas seulement deux produits concurrents: ils sont les marqueurs d’une industrie qui bascule d’une course aux capacités vers une course à la maîtrise, où l’infrastructure, la confiance et la distribution valent autant que le modèle lui-même.